7��30�գ�������ά��ʽ�Ƴ�����Դ�����Իع�·�ߵġ���ģ̬ͳһԤѵ��ģ�� Skywork UniPic�����ڵ�һģ��������ں�ͼ�����⡢�ı���ͼ�����ɡ�ͼ��༭���������������ģ�ͻ��ڴ��ģ���������ݽ��ж˵���Ԥѵ�����߱����õ�ͨ�������Ǩ���ԡ�

���ֿ���Э�����������µ����������ά��������ȫ�濪�� Skywork UniPic �ĺ�����Դ��

ģ��Ȩ����

https://huggingface.co/Skywork/Skywork-UniPic-1.5B

����������

https://github.com/SkyworkAI/UniPic/blob/main/UNIPIC.pdf

����ֿ���

https://github.com/SkyworkAI/UniPic

01

Skywork UniPic��ͳһ�Իع�ģ��ʵ��ͼƬ���ɡ��༭������һ�廯

GPT-4o��Ѹ���ߺ죬��ע���˹����������ģ̬ͳһԤѵ��ģ�͵ij��졣Skywork UniPic ������ GPT-4o ���Իع鷶ʽ���ڵ�һģ��������ں�ͼ�����⡢�ı�����ͼ��T2I����ͼ��༭�������������������ͳһ�Ķ�ģ̬ģ�ͼܹ���

��ͳ��ģ̬ͳһģ�Ͷ����� VQ �� VAE ��������ѹ���Ӿ����ݣ���Ȼ�߱�һ��Ч������Ҳ���ھ����ԣ����Ǹ����ر���ͼ����Ӿ�ϸ�ڶ���������Ϣ�������һ���̶�������ģ�͵�ͼ������������

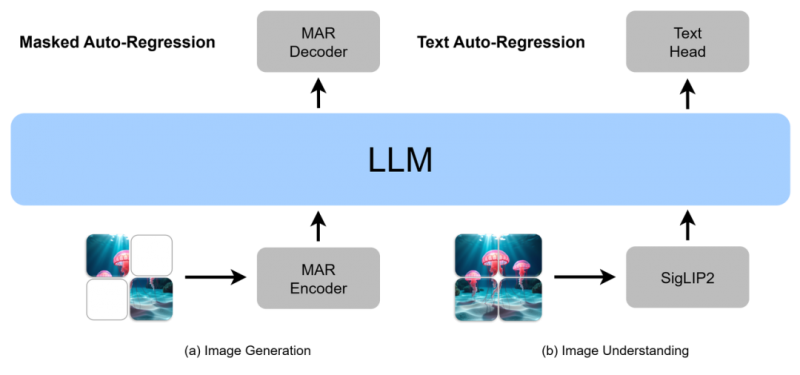

Ϊ�ˣ�Skywork UniPic �Ŷӽ�� Harmon �ܹ���ƣ����ڱ�����ʽ�������ؼ����������� MAR ��������Ϊͼ������·�����Ӿ�����������ͬʱ���� SigLIP2 ��Ϊͼ������·�������ɡ�

�ýṹ��Ƶĺ��Ķ������ڣ��ܷ�һ��������ͳһģ�ͣ��ڱ���ʵ�ʲ�������Ե�ͬʱ�������⡢������༭�����Ͼ��ﵽ�������ܣ�

Skywork-UniPic ģ�ͺ�������������

ͼ�����⣺���� token Ԥ������ı����Իع齨ģ

ͼ�����������������Իع鷽ʽ��������ͼ�� patch

ͼ��༭������ο�ͼ��༭ָ����Ϊ���������ɱ༭���ͼ��

���⣬Skywork-UniPic ��ɶ˵����Ż����̣��ܹ�ʵ�����ɡ����⡢�༭����������Эͬѵ������ٽ���ͻ�ƴ�ͳ����������Ȩ��ļ���ƿ����

��һ�ܹ���Ʋ����������Իع�ģ�͵ļ���Ч����ͨ������������ʵ���˿���������Эͬ��Ϊ��ģ̬ͳһģ�͵�ʵ�û�����춨�˼�ʵ������

�û�ֻ��Ҫ������ʾ�ʣ�Skywork-UniPic �ȿ����� VLM һ������ͼ���� T2I ģ��һ������ͼƬ������������ͼ����һ����һ��ʵ�ַ��ת��/���������ı༭���ܡ�

02

ģ�����ƣ�1.5B ��������ģ���ܱƽ�ͬ������ͳһģ�ͣ�ڹ���ˡ�С�������ļ�����ѧ

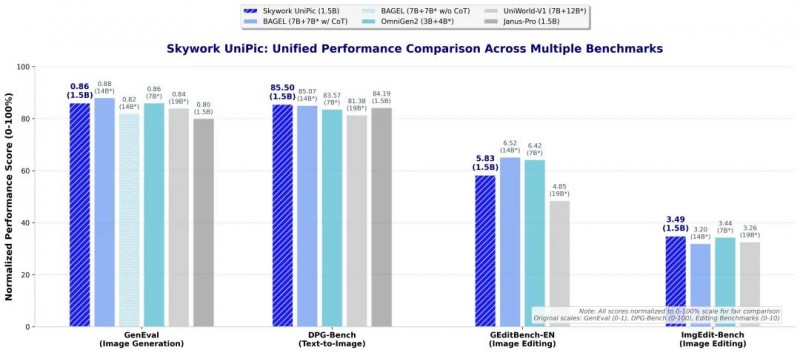

�Ŷ�����ģ����������ͬʱ��Ҳ���Ч����Ҫ�Ե�������Skywork UniPic �� 1.5B �Ľ��ղ�����ģ������ڹ���ˡ�С�������ļ�����ѧ��

���ؼ�������

ָ����ѭ������������ģ�ͣ��� GenEval ָ����ѭ������ȡ�� 0.86 ������ɼ�����Խ�˾������ͬ��ͳһģ�ͣ����� CoT �������ȡ���� SOTA �������ƽ��ϴ�ģ�� BAGEL��7B+7B*���� CoT �� 0.88 �֣�

����ָ����ͼ�������ȣ��� DPG-Bench ����ָ����ͼ���ϴﵽ 85.5 �ֵ���ҵ SOTA ˮƽ��

ͼ��༭����ͳһģ�͵�һ�ݶӣ�GEditBench-EN ��� 5.83 �֣�ImgEdit-Bench �ﵽ3.49�֣�չ�ֳ����ı༭ִ��������

����Ч���������������ͬ������ͳһģ�ͣ��� BAGEL �� 14B �ܲ�����UniWorld-V1 �� 19B �ܲ�������Skywork UniPic �� 1.5B ����������ģʵ���˽ӽ�������Խ�����ģ�͵����ܱ��֣�

�����Ѻã���������أ�ģ���� RTX 4090 ���Ѽ��Կ��Ͼ����������У�Ϊ����ߺ��о����ṩ���������䣬�ص�ͳһģ�ͽ����������������˼���Ӧ���ż���

03

Skywork-UniPic���������ɵģ�

📖 ���ݹ������ڼ����������Ͽ�֧��ͳһģ��Ԥѵ��

���ȣ�Skywork UniPic ��Խ���ܣ�����Դ�����ݶѵ������������ǵ�����һ���߶Ⱦ�����ϵͳ�Ż������ݹ�����ϵ��

�Ŷ�ͻ���ˡ�����ǿ���Ĵ�ͳ��֪�߽磬ͨ��Լ�ڼ���ģ�ľ�ѡԤѵ��������������������SFT���������ɹ�������һ���������⡢������༭��������������Ч�ܶ�ģ̬ѵ�����Ͽ���

��һ������ϵ���������Ͽⲻ������ѹ����ѵ����Դ�ɱ�������ģ�ͷ�������������Ǩ�Ʊ�����չ�ֳ����˵��Լ۱ȣ������֤��С��ģ����ɸѡ�����������ݶ�ͳһ��ģ̬ģ��ѵ���Ŀ�������DZ����

📖 ����ģ������������������������������ϵ

��Σ�Ϊ��ȷ�� Skywork UniPic ��ͼ�����ɺͱ༭�����ϵ�Խ���֣����������ר����ͼ�����ɵ�Reward Model��Skywork-ImgReward����ר����ͼƬ�༭��Reward Model (Skywork-EditReward����

���У�Skywork-ImgReward�ǻ���ǿ��ѧϰѵ����Reward Model�����������T2I Reward Model��Skywork-ImgReward�ڶ������ͼ�����µ�ƫ��ѡ����ֶ����ӽ�����ƫ�á���������������Ϊ����ͼ����������ɸѡ��Ҳ�����ں���������ͼ����������ǿ��ѧϰѵ���еĽ����źţ��Լ���Ϊ����ͼ�����������ָ�ꡣ

ͬʱ���ͼ��༭��һ������ս�����Ǵ����Եع����˾�������Ե�Skywork-EditReward���䱻����������������ʱ�����Զ�������30%�ĵ������༭�������� GEditBench-EN �� ImgEdit-Bench �������б������Ը��ơ�����ͬ��Ҳ���Ա�����ͼ��༭ǿ��ѧϰѵ���еĽ����źţ��Լ���Ϊͼ��༭����������ָ�ꡣ

💡 ѵ����ϵ�Ż����������

MARѵ���Ż���ϵ��Ϊ����ģ�ͱ��֣����Dz���������ؼ��Ż����ԣ����ȣ������ݲ������븲�Ǹ����Ӿ������������ڼ�ר��ͼ�����ݣ�������չ��ģ�͵�ѧϰ�ռ䡣��Σ�ѵ�������в��ý���ʽ�ֱ����������ԣ�����256��256�ֱ����½����ȶ��ĵײ�������ȡ����������Ǩ����512��512������ǿģ�͵����������ϸ���Ƚ�ģ������

HARMONѵ���Ż���ϵ��Ϊ��һ������ģ�����ܲ����ѵ��Ч�ʣ���������˶�ηֲ�ֱ���ѵ�����ơ��ڵ�һ�Σ�ģ����512��512�ֱ����½��������۽�����������ȡ���ȶ����������ԡ��������������ֱ�����1024��1024����ʹģ���õز���������Ե�ȸ߾���ϸ����Ϣ��

ͬʱ�����Dz��÷ֽβ����ⶳ���ԣ����ͷ�ģ���������ڳ�ʼ�Σ���ѵ��Projectorģ����ʵ���Ӿ������������Ķ��룬�������������LLM�����������ڱ���LLM�����������ǰ�����Ż��Ӿ����ɣ�������ȫ���ⶳ�Σ����ж˵��������Ż���ʵ�ֶ�ģ̬Эͬ��ǿ��

����ʽ������ѵ�����ԣ�Ϊ������⡢���ɺͱ༭�����������Լ�õ����⣬�����������ʽ������ѵ�����ơ�

ѵ�����ڣ�ģ����רע�ڵ�һ�������ı�����ͼ������������������������༭�����������ѵ�˳�������������Ӷȣ������������������š��ھ�ϸ���Σ�����ͨ������ģ��ɸѡ����������ѵ�����ݣ����ö�̬��ֵ������Բ������ԣ�ȷ�������Ⱦ߸����Ŷ��־���������ԡ�

�������������ϲ�����ѵ��������ʵ���˽ṹ�����������ͷź�������Ӧ������������ģ�������⡢���ɺͱ༭�������ϵ�ͳһ���֣�������������ϵġ�һר���ܡ���

��ȥ���꣬������ά�Ѿ���Դ�˶��SOTA��ģ�ͣ����ǽ���ģ�͡��������������̡���ģ̬���ռ����ܵ������죬Skywork-UniPic ��ʽ���롸Skywork����Դ���ͥ����AI������Ϊÿ���˴��ֿɼ��Ĵ����顣

������ά��Դϵ��

🔗 ���� Skywork ϵ�п�Դģ�ͣ��ɲ鿴��https://huggingface.co/Skywork