CVPR2025:快手可灵四大技术方向布局视频生成及世界模型

近日,全球视觉AI领域的年度盛会CVPR 2025在美国田纳西州纳什维尔召开,快手可灵AI事业部万鹏飞博士在备受瞩目的“From Video Generation to World Model” Tutorial(《从视频生成到世界模型》专题讲座)上,发表了题为An Introduction to Kling and Our Research towards More Powerful Video Genaration Models的报告,从模型架构与生成算法、互动与可控能力、效果评估与对齐机制、多模态理解和推理四大技术方向介绍了可灵AI团队在视频生成及世界模型领域的最新进展与思考。

先进的模型结构与生成算法(Advanced Model Architectures and Generation Algorithms)

Scaling laws在大语言模型中已经有众多研究工作和实际应用,但视频生成领域缺乏精准好用的scaling laws公式。可灵团队通过严谨的实验与分析,首次建立了超参数、模型规模与计算预算之间的精确数学关系。这个成果让我们可以更科学地设置模型参数规模和关键参数,从而更充分的发挥算力和数据资源的价值,达成更优的模型效果。参考论文:Towards Precise Scaling Laws For Video Diffusion Transformers

可灵团队还推出了面向扩散模型的混合专家(MoE)架构DiffMoE。基于全局范围的token选择机制和配套的推理策略,DiffMoE可根据扩散模型在不同生成阶段的异构特性,更合理地分配计算资源。在图像生成中,仅需激活1倍的参数量,便能达到3倍规模的密集模型的生成性能。参考论文:DiffMoE: Dynamic Token Selection For Scalable Diffusion Transformers

强大的交互与可控能力(Powerful Interaction and Control Capacities)

可灵团队提出了一个多任务视频生成模型框架FullDiT,将所有时空条件作为上下文无缝融合到一个统一的Diffusion Transformer架构中。FullDiT不需要针对不同任务更改模型结构,降低了各种不同控制条件之间的冲突,且展示出了优秀的可扩展性甚至涌现能力。参考论文:FullDiT: Multi-Task Video Generative Foundation Model with Full Attention

在交互式视频生成方向,可灵团队提出了GameFactory框架,只需少量带有动作控制信息的视频训练数据,即可支持可泛化到不同游戏场景的连续(如鼠标)和离散(如键盘)的动作控制能力。参考论文:GameFactory: Creating New Games with Generative Interactive Videos

准确的评估和对齐机制(Accurate Evaluation and Alignment Mechanisms)

可灵团队构建了一套基于人类反馈的强化学习(RLHF)的视频生成框架,包括多维偏好数据构造、基于VLM的Reward模型,以及多种对齐算法。该框架是最早的系统性阐述如何应用RLHF到视频生成任务的工作之一。参考论文:Improving Video Generation with Human Feedback

此外,面向图像和视频生成领域主流的流匹配(Flow Matching)生成算法,团队通过ODE-to-SDE(常微分方程转换到对应的随机微分方程)等方案,有效解决了流匹配缺乏随机性以及多步生成计算效率低的问题,提出了首个将GRPO引入流匹配模型的在线强化学习(RL)算法Flow-GRPO,并证明了其在图像生成任务中的有效性。参考论文:Flow-GRPO: Training Flow Matching Models via Online RL

多模态感知与推理(Multimodal Perception and Reasoning)

视频captioner(视频内容的文本描述模型)对最终的视频生成效果非常关键,但行业中缺乏好的效果评估的方法。可灵团队提出一个视频captioner评估框架VideoCapBench,具备稳定性和可靠性更高、以及与最终视频生成效果相关性强的优点。参考论文: VidCapBench: A Comprehensive Benchmark of Video Captioning for Controllable Text-to-Video Generation

面向用户意图理解,可灵团队提出的Any2Caption按照一种统一的方式理解多模态用户输入信息,进而生成语义丰富的结构化描述,可显著提升视频生成的成功率。参考论文:Any2Caption: Interpreting Any Condition to Caption for Controllable Video Generation

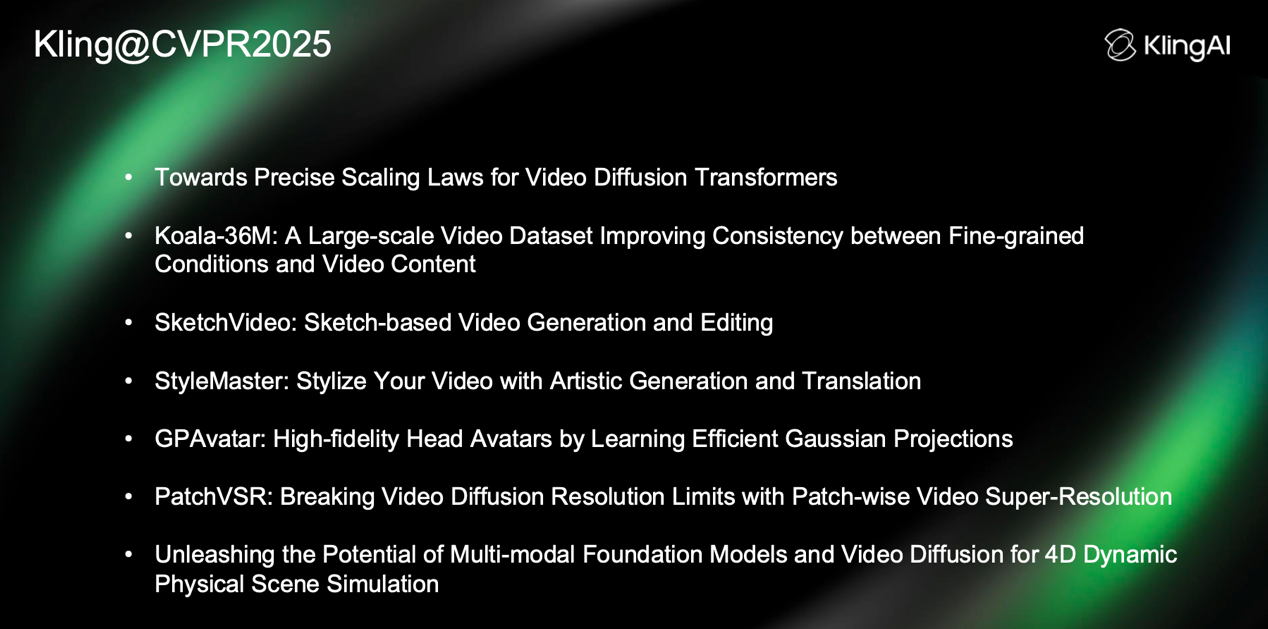

除tutorial报告外,本届CVPR上可灵共有7篇论文入选,涵盖视频模型scaling law、视频数据集、可控生成、人像生成、高清生成、4D生成等多个方向。

1.本网刊载内容,凡注明来源为“飞象网”和“飞象原创”皆属飞象网版权所有,未经允许禁止转载、摘编及镜像,违者必究。对于经过授权可以转载,请必须保持转载文章、图像、音视频的完整性,并完整标注作者信息和飞象网来源。

2.凡注明“来源:XXXX”的作品,均转载自其它媒体,在于传播更多行业信息,并不代表本网赞同其观点和对其真实性负责。

3.如因作品内容、版权和其它问题,请在相关作品刊发之日起30日内与本网联系,我们将第一时间予以处理。

本站联系电话为86-010-87765777,邮件后缀为cctime.com,冒充本站员工以任何其他联系方式,进行的“内容核实”、“商务联系”等行为,均不能代表本站。本站拥有对此声明的最终解释权。

5G-A赋能机器人火炬接力:中国移动以技术革新点亮全运科技盛宴

2025年11月,第十五届全国运动会将在粤港澳三地盛大启幕。这场赛事不仅是体育健儿的竞技场,更是前沿科技落地应用的“试验田”。其中,11月2日的机器人火炬接力作为本次全运会的核心创新亮点..[详细]

轻薄机型出师未捷身先死,长使业绩泪满襟

当iPhone Air宣布上市当天,随着各路评测内容解禁,一个显眼的标题也随之出现,那就是“注定停产”。轻薄机型的出现一方面让人们看到厂商正在挖掘全新市场空间,另一方面也勾起了小尺寸机型..[详细]

智能未来:宇宙为你闪烁

未来十年,你家的电表可能再也不用换电池,自动驾驶汽车能"看到"几公里外的路况,甚至海洋深处的传感器都能实时传回数据。这些不是科幻,而是刚刚在无锡物博会上发布的《2025全球..[详细]

智能IP广域网成为筑牢智算产业发展根基的关键一环

随着国家加速推动智算产业高质量发展,网络支撑能力已成为产业进阶的核心抓手,而作为关键基础设施的智能IP广域网,正凭借其在算力调度、数据传输中的核心作用,成为筑牢智算产业发展根基的..[详细]

大中华区市场失守 苹果寄望AI驱动未来增长

苹果公司公布的2025 财年第四季度财报呈现“冰火两重天”态势:全球营收1024.66亿美元同比增长 8%,净利润274.66亿美元同比激增86.4%,毛利率攀升至 47.18%。但作为第三大市场的大中华区却成..[详细]